棣山科技基于事件的视觉传感器:仿若视神经的“觉醒之眼”,开启AI与机器人的无限可能

在人工智能与机器人技术迅猛发展的今天,感知系统正经历一场深刻的范式变革。传统帧式图像传感器如同“机械之眼”,以固定频率捕捉画面,无论场景是否变化,均产生大量冗余数据,不仅占用带宽与算力,更难以应对高速运动与极端光照场景。例如,在处理快速移动的物体时,传统传感器可能会产生运动模糊,而在强光或弱光环境下,画面质量会显著下降,影响后续的图像分析和决策。而棣山科技推出的基于事件的视觉传感器(Event-based Vision Sensor),正以革命性的方式模仿人类视神经的工作机制,只对场景中的“变化”做出响应,为AI与机器人开辟出一个充满可能性的广阔世界。这不仅是技术的飞跃,更是一场对感知本质的重新定义,让机器真正学会“像生命一样看世界”。

仿生之智:像视神经一样“只看变化”

人类视觉系统的高效运转堪称生物进化的奇迹——当视野中没有物体移动或光照突变时,视神经几乎不向大脑传递信号;唯有动态变化发生,神经脉冲才会被触发。这种“稀疏编码”机制极大节省了能量与信息处理负担,使我们能在复杂环境中精准捕捉关键信息。棣山科技的事件视觉传感器正是受此启发,摒弃传统“逐帧拍摄”模式,采用“异步事件驱动”机制:每个像素独立工作,仅在检测到光强变化超过阈值时,才输出一个“事件”信号,包含时间、位置和变化极性(变亮或变暗)。这一机制完美复刻了生物视觉的“事件驱动”特性,让传感器从“被动记录”转向“主动感知”。

这种工作方式带来的优势远超想象:超低延迟让事件响应速度可达微秒级,比传统传感器的毫秒级帧周期快了三个数量级,快如闪电,足以捕捉子弹轨迹或高速机械臂的细微动作;超高动态范围突破120dB,能在正午强光下看清阴影中的细节,或在一瞬间适应从暗室到户外明暗骤变的场景,如同人类的视觉适应;极低功耗与数据量更是颠覆性突破——仅传输变化信息,数据量减少90%以上,这意味着传感器在边缘设备上可长时间运行,无需频繁传输数据或更换电池,仿佛拥有了节制的智慧。这种仿生设计不仅提升了性能,更让机器感知系统拥有了接近生命的“节能智慧”。

技术跃迁:从“被动记录”到“主动感知”的智能进化

传统视觉系统如同一个“被动记录者”,机械地按照预设帧率输出画面,无论场景是否静止。而棣山科技的事件传感器彻底打破这一桎梏,成为“主动感知者”。它不再被固定帧率束缚,能够实时捕捉高速运动轨迹、瞬态光照变化与微小振动,为AI系统提供更精准、更及时的输入。例如,在工业流水线上,当传送带以每秒数米的速度运转时,传统摄像头可能因运动模糊而丢失关键信息,而事件传感器却能清晰记录每个零件的微小位移,实现毫秒级反馈。

在算法层面,棣山科技同步开发了配套的事件流处理引擎,将前沿的脉冲神经网络(SNN)与深度学习模型深度融合。这种混合架构既利用了SNN处理时序事件数据的高效性,又结合了深度学习的泛化能力。系统不仅能实时解析事件流,还能进行复杂推理:无论是动态目标跟踪(如预测飞行物体的轨迹)、运动预测(如预判机械臂下一步动作),还是异常行为识别(如检测生产线上的突发故障),都能以极低算力完成高精度判断。这种“感知-决策-行动”的闭环优化,让智能系统真正具备实时响应能力,仿佛拥有了生物的“条件反射”。

赋能AI与机器人:开启全新应用场景的无限想象

基于事件的视觉技术,正为多个前沿领域注入新动能,重塑行业的未来图景:

自动驾驶: 在高速公路上,传统摄像头可能因运动模糊或强光反射而失效,但事件传感器却能精准捕捉到突然横穿的行人或车辆,将感知延迟降至微秒级,为紧急避障赢得关键时间。同时,其高动态范围特性让系统在隧道出入口等明暗交替场景中依然稳定工作,大幅提升行车安全。

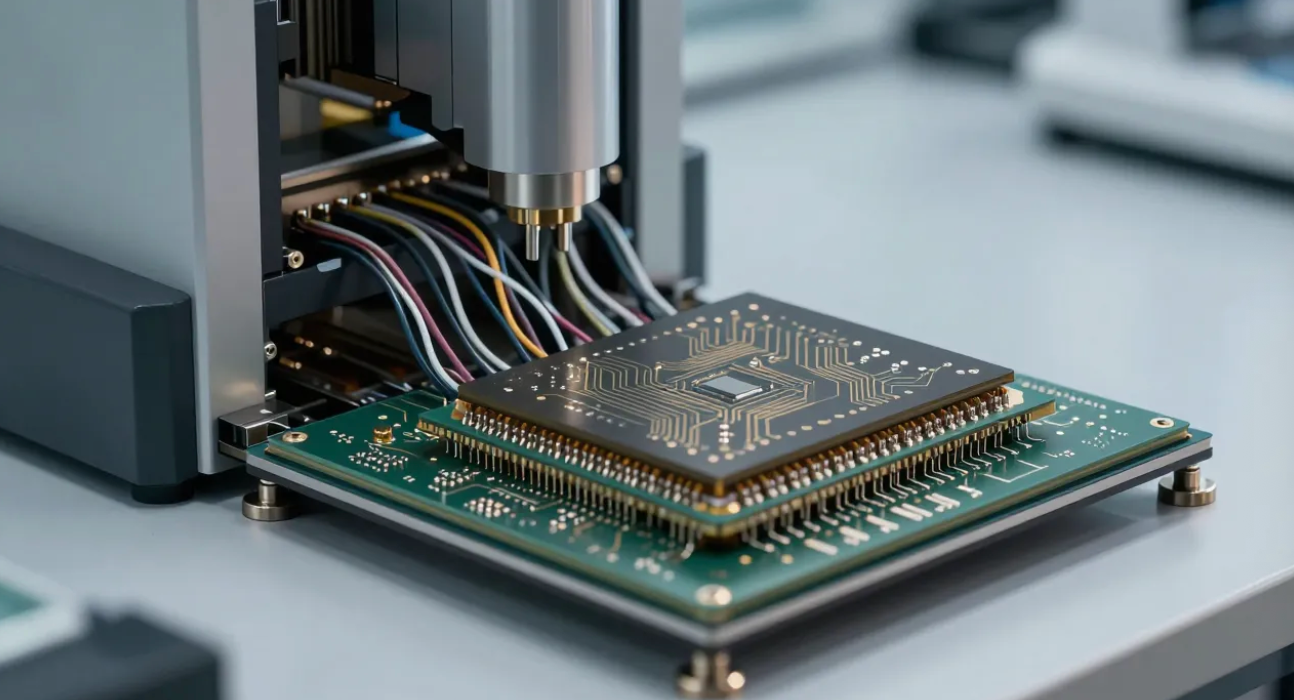

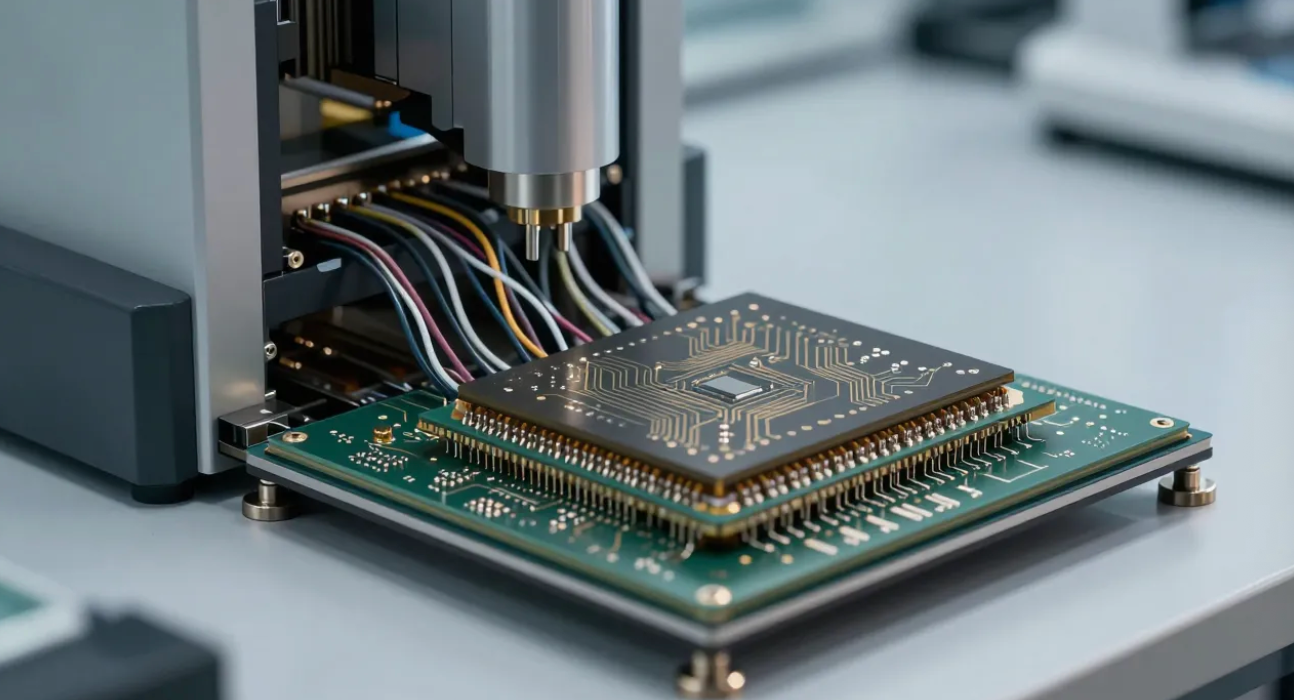

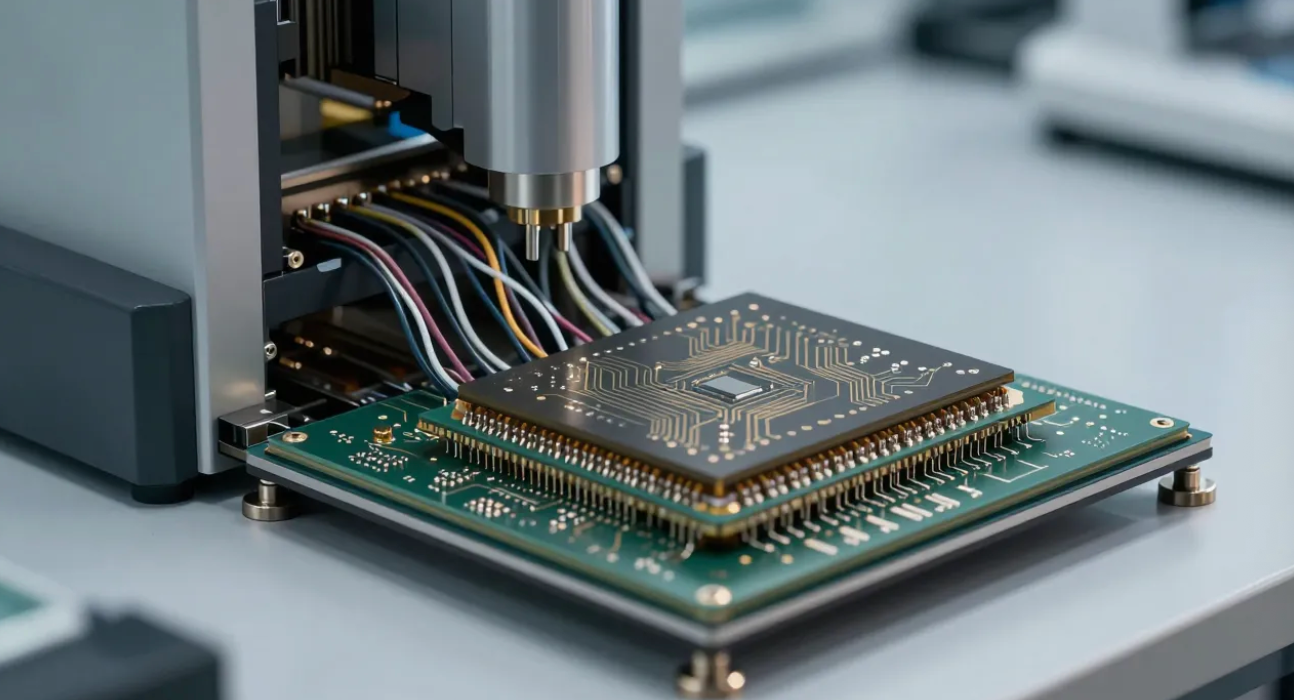

工业机器人: 在精密制造领域,事件视觉可实时反馈微米级的位移变化,助力机械臂完成超高速分拣或纳米级装配任务。例如,在芯片封装过程中,传感器能即时检测到晶圆表面的微小振动,确保操作精度达到原子级。

无人机与无人系统: 在复杂地形或弱光环境中,事件传感器凭借高动态与低延迟优势,使无人机能够稳定穿越森林、洞穴或夜间执行任务。其低功耗特性更延长了续航时间,让长时间作业成为可能。

智能监控与安防: 传感器只对真实运动事件响应,有效过滤风吹草动、光影变化等静态干扰,将误报率降低至接近零。同时,由于数据量大幅减少,存储成本骤降90%以上,让大规模部署成为现实。

人机交互与AR/VR: 通过捕捉用户微表情、眼球运动甚至瞳孔变化,事件传感器为AR/VR设备提供更自然的交互体验。例如,在虚拟会议中,系统可实时识别用户的注视方向,调整画面渲染优先级,带来更沉浸的体验。

医疗健康: 在神经科学研究中,传感器的高时间分辨率特性使其能记录视网膜神经元的放电活动,为疾病诊断提供新工具;在康复训练中,可精准捕捉患者细微动作,辅助制定个性化治疗方案。

未来图景:构建“类生命感知”的智能生态

棣山科技的探索,不止于单一传感器的突破,更在于构建一种“类生命感知”的技术范式。他们正与全球顶尖高校、研究机构及产业伙伴紧密合作,推动事件视觉与多模态感知深度融合:例如,事件+事件热成像融合系统,能在完全黑暗或烟雾环境中实现三维感知;事件+LiDAR组合则将动态视觉与深度信息结合,为自动驾驶提供更全面的环境理解。这些技术融合正让机器人感知系统逐步接近人类感官的丰富性与鲁棒性。

展望未来,机器人将不再“笨拙地看世界”,而是像人类一样,只关注变化、理解动态、预测趋势。在智能工厂中,机械臂能够精准地识别零部件的位置和状态变化,即使在高速运转的生产线上也能像熟练工匠般灵活操作。在复杂的交通环境中,无人车能通过感知周围环境的变化,如突然出现的行人或障碍物,及时调整行驶路线和速度,从而在暴雨等恶劣天气中稳健行驶。服务机器人则能敏锐捕捉用户的情绪变化,通过分析面部表情和语音语调,做出自然且恰当的反应,如在用户表现出烦躁时,主动提供舒缓的音乐或放松的建议。这不仅是技术的进化,更是智能体与环境关系的重塑——机器开始从“适应环境”转向“理解环境”,最终实现“与环境共舞”。

以“事件”之眼,看见未来

棣山科技基于事件的视觉传感器,不只是技术的升级,更是一次对“感知本质”的哲学思考。它如同人类视神经的电子化身,以极简的方式,捕捉世界最真实的动态脉动。在这双“觉醒之眼”的注视下,AI将更敏锐,机器人将更灵动,智能世界将更贴近生命的智慧。当机器学会“只看变化”,它们便真正开始理解世界的节奏——那由无数细微运动、光影流转与能量变化交织而成的生命韵律。

今天,棣山科技用这场视觉革命点亮了第一束光;未来,当万千“觉醒之眼”遍布世界,我们将见证一个前所未有的智能纪元:在那里,机器不仅是工具,更是理解生命、延续文明的新伙伴。这场感知革命,正在为人类智能的下一次飞跃,铺就通往星辰大海的道路。